阿里巴巴、智源研究院、清华大学联合发布全新AI模型,可赋予AI认知能力

1月12日,阿里巴巴、智源研究院、清华大学等联合研究团队发布面向认知的超大规模新型预训练模型“文汇”。该模型不仅能提升AI的理解能力,还可基于常识实现AI创作,未来将应用于文本理解、人机交互、视觉问答等场景。

与传统AI训练需要人工标注数据不同,面向认知的预训练语言模型提供了一种全新的学习思路,即AI首先自动学习大量语言文字和图像数据,记忆和理解其中的信息以及人类语言表述的规律后,再进一步学习专业领域知识,从而让AI同时掌握常识和专业知识。

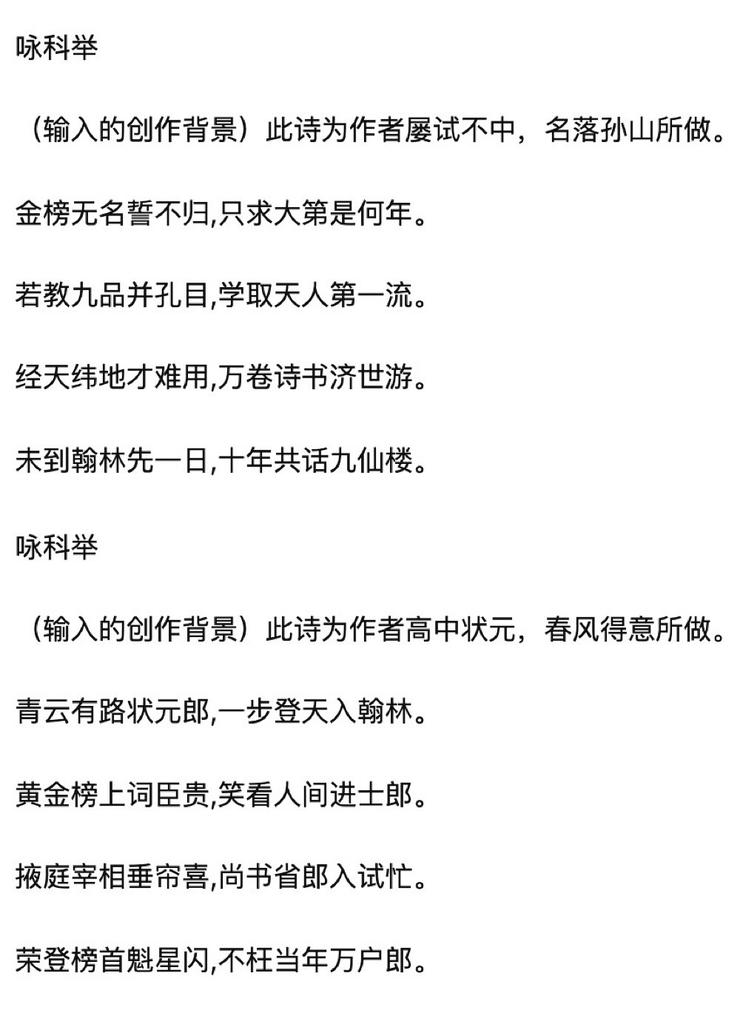

此次发布的“文汇”是目前国内规模最大的预训练模型,参数量级达113亿,采用阿里自研的统一多种并行策略的高性能分布式框架,使用模型并行、流水并行、数据并行训练进行分布式训练。“文汇”突破了多模态理解与多模态生成两大难题,可轻松理解文本图像信息,并能完成创造性任务。例如,仅需输入诗歌题目、朝代以及作者,“文汇”即可自动生成仿古诗词。目前,“文汇”已支持基于认知推理的多种自然语言及跨模态应用任务,部分应用即将上线。

模型可根据诗歌题目、朝代以及作者自动生成诗歌

达摩院2020十大科技趋势曾提到:AI已经在“听、说、看”等感知智能领域达到或超越了人类水准,但其逻辑推理能力依旧处于初级阶段,多模态预训练模型是实现感知智能向认知智能跨越的关键基础。达摩院智能计算实验室负责人周靖人表示,“预训练语言模型是过去70多年以来最具创新的自然语言模型之一,其模型设计难度也远高于传统模型,达摩院研究团队将持续攻克算法及系统工程难题,加速人工智能走向认知智能。”

作为国内最早投入认知智能研究的科技公司之一,阿里巴巴已有30多个研究成果被国际顶级会议收录,获得世界人工智能大会最高奖项—SAIL奖,与清华大学联合获得国家科学技术进步奖二等奖,旗下图神经网络框架Graph Learn已面向全球开源,可减少模型的算力、存储资源消耗,同时缩短算法开发上线周期。

相关阅读

-

云安全日报210527:Ubuntu配套LZ4解压缩软件发现执行任意代码漏洞,需要尽快升级

Ubuntu是一个以桌面应用为主的Linux操作系统。它是一个开放源代码的自由软件,提供了一个健壮、功能丰富的计算环境,既适合家庭使用又适用于商业环境。Ubuntu将为全球数百个公司提供商业支持。 ...

查看全文 -

云计算核心技术Docker教程:清理未使用的Docker对象

Docker采取了一种保守的方法来清理未使用的对象(通常称为“垃圾收集”),例如图像,容器,卷和网络:除非您明确要求Docker这样做,否则通常不会删除这些对象。这可能会导致Docker使用额外的磁盘空...

查看全文 -

消息称亚马逊、微软、谷歌正竞购波音公司10亿美元云合同

新浪科技讯 北京时间5月27日晚间消息,据报道,四位知情人士今日透露,亚马逊、微软和谷歌这三大云计算服务提供商,正在竞争波音公司(Boeing)价值10亿美元的云服务合同。 这些...

查看全文 -

亚马逊难逃反垄断惩罚?美国又有三个州加入调查

新浪科技讯 北京时间5月27日晚间消息,据报道,多位知情人士今日称,继加州、纽约州和华盛顿州之后,马萨诸塞州和宾夕法尼亚州的总检察长也加入到对亚马逊的反垄断调查中。 如今,越来越...

查看全文

您好!请登录