手把手教你对文本文件进行分词、词频统计和可视化(附源码)

大家好!我是Python进阶者。

前言

前几天一个在校大学生问了一些关于词频、分词和可视化方面的问题,结合爬虫,确实可以做点东西出来,可以玩玩,还是蛮不错的,这里整理成一篇文章,分享给大家。

本文主要涉及的库有爬虫库requests、词频统计库collections、数据处理库numpy、结巴分词库jieba 、可视化库pyecharts等等。

一、数据来源

关于数据方面,这里直接是从新闻平台上进行获取的文本信息,其实这个文本文件可以拓展开来,你可以自定义文本,也可以是报告,商业报告,政治报告等,也可以是新闻平台,也可以是论文,也可以是微博热评,也可以是网易云音乐热评等等,只要涉及到大量文本的,都可月引用本文的代码,进行词频分词、统计、可视化等。

二、数据获取

数据获取十分简单,一个简单的爬虫和存储就可以搞定,这里以一篇新闻为例进行演示,代码如下:

import re import collections # 词频统计库 import numpy as np # numpy数据处理库 import jieba # 结巴分词 import requests from bs4 import BeautifulSoup from pyecharts import options as opts from pyecharts.charts import WordCloud from pyecharts.globals import SymbolType import warnings warnings.filterwarnings(ignore) r=requests.get(“https://m.thepaper.cn/baijiahao_11694997″,timeout=10) r.encoding=”utf-8″ s=BeautifulSoup(r.text,”html.parser”) f=open(“报告.txt”,”w”,encoding=”utf-8″) L=s.find_all(“p”) for c in L: f.write(“{} “.format(c.text)) f.close()

代码运行之后,在本地会得到一个【报告.txt】文件,文件内容就是网站上的文本信息。如果你想获取其他网站上的文本,需要更改下链接和提取规则。

三、词频统计

接下来就是词频统计了,代码如下所示。

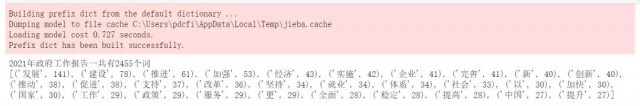

# 读取文件 fn = open(“./报告.txt”,”r”,encoding=”utf-8″) string_data = fn.read() fn.close() # 文本预处理 # 定义正则表达式匹配模式 pattern = re.compile(u |,|/|。| |.|-|:|;|)|(|?|”) string_data = re.sub(pattern,,string_data) # 将符合模式的字符去除 # 文本分词 # 精确模式分词 seg_list_exact = jieba.cut(string_data,cut_all=False) object_list = [] # 自定义去除词库 remove_words = [u的,uҪ, u“,u”,u和,u,,uΪ,u是, 以 u随着, u对于, u对,u等,u能,u都,u。, u ,u、,u中,u在,u了,u通常,u如果,u我, u她,u(,u),u他,u你,u?,u—,u就, u着,u˵,u上,u这, u那,u有, uҲ, uʲô, u·, u将, u没有, u到, u不, uȥ] for word in seg_list_exact: if word not in remove_words: object_list.append(word) # 词频统计 # 对分词做词频统计 word_counts = collections.Counter(object_list) # 获取前30最高频的词 word_counts_all = word_counts.most_common() word_counts_top30 = word_counts.most_common(30) print(“2021年政府工作报告一共有%d个词”%len(word_counts)) print(word_counts_top30)

首先读取文本信息,之后对文本进行预处理,提取文字信息,并且可以自定义词库,作为停用词,之后将获取到的词频做词频统计,获取前30最高频的词,并进行打印,输出结果如下图所示。

四、可视化

接下来就是可视化部分了,这里直接上代码,如下所示。

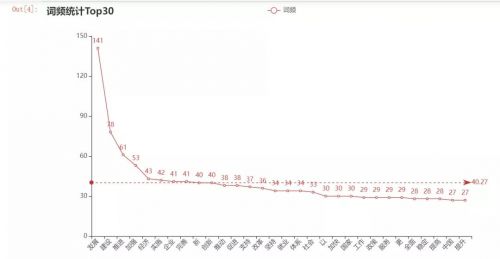

import pyecharts from pyecharts.charts import Line from pyecharts import options as opts # 示例数据 cate = [i[0] for i in word_counts_top30] data1 = [i[1] for i in word_counts_top30] line = (Line() .add_xaxis(cate) .add_yaxis(词频, data1, markline_opts=opts.MarkLineOpts(data=[opts.MarkLineItem(type_=”average”)])) .set_global_opts(title_opts=opts.TitleOpts(title=”词频统计Top30″, subtitle=””), xaxis_opts=opts.AxisOpts(name_rotate=60,axislabel_opts={“rotate”:45})) ) line.render_notebook()

输出结果是一个线图,看上去还不错。

五、总结

本文基于Python网络爬虫获取到的文本文件,通过词频、分词和可视化等处理,完成一个较为简单的项目,欢迎大家积极尝试。在代码实现过程中,如果有遇到任何问题,请加我好友,我帮助解决哦!

相关阅读

-

云安全日报210527:Ubuntu配套LZ4解压缩软件发现执行任意代码漏洞,需要尽快升级

Ubuntu是一个以桌面应用为主的Linux操作系统。它是一个开放源代码的自由软件,提供了一个健壮、功能丰富的计算环境,既适合家庭使用又适用于商业环境。Ubuntu将为全球数百个公司提供商业支持。 ...

查看全文 -

云计算核心技术Docker教程:清理未使用的Docker对象

Docker采取了一种保守的方法来清理未使用的对象(通常称为“垃圾收集”),例如图像,容器,卷和网络:除非您明确要求Docker这样做,否则通常不会删除这些对象。这可能会导致Docker使用额外的磁盘空...

查看全文 -

消息称亚马逊、微软、谷歌正竞购波音公司10亿美元云合同

新浪科技讯 北京时间5月27日晚间消息,据报道,四位知情人士今日透露,亚马逊、微软和谷歌这三大云计算服务提供商,正在竞争波音公司(Boeing)价值10亿美元的云服务合同。 这些...

查看全文 -

亚马逊难逃反垄断惩罚?美国又有三个州加入调查

新浪科技讯 北京时间5月27日晚间消息,据报道,多位知情人士今日称,继加州、纽约州和华盛顿州之后,马萨诸塞州和宾夕法尼亚州的总检察长也加入到对亚马逊的反垄断调查中。 如今,越来越...

查看全文

您好!请登录